2026年1月9日

昨日计划完成情况 去50所好好上班 —— 完成,搞道路病害计算 闲下来折腾小程序 —— 没来得及,太累了 今日记录白天 @ 50所 道路病害计算任务推进,用A4纸面积迁移的算法思路,跑通了但效果一般,后续还得优化 三创赛报名折腾了好久,各种小问题连续填了三次,差点被填崩溃 晚上 回来比较累,吃了顿大的(大份鸡柳+鸡腿饭),吃撑了 散步半小时,顺便给爱车充电 读完Day08论文,没怎么干其他活 状态精力 6/10,情绪 6/10 三创赛报名反复填表把心态搞崩了,感情上也有点爆炸,整个人像个没有感情的杀手。 健康打卡 早餐:牛肉饼 午餐:50所食堂 晚餐:大份鸡柳 + 鸡腿饭(吃撑了,25元的大份) 散步:✅ 半小时 喝水:✅ 2000ml 今日收获 道路病害算法思路跑通,虽然效果待优化 DETR论文读完,Day08打卡成功 今日卡点 道路病害计算效果不理想,A4面积迁移方案有局限 三创赛报名系统反复折腾 感悟 故事的主角在失败后都这样,他们会陷入无尽的沉思和沮丧中,自责到无法自拔。 但主角之所以是主角,是因为他们最后都爬起来了。累了就歇,明天继续。 明日计划 ...

专业课第二次作业

第二次作业1.求n的阶乘n的阶乘=n * n-1 * n-2 * n -3…* 2 * 1 1234567891011#include<iostream>using namespace std;int main(){ int n,s=1; cin>>n; for(int i=1;i<=n;i++){ s*=i; } cout<<s<<endl; return 0;} 14.从键盘输入10个整数,统计其中正数、负数和零的个数,并在屏幕上输出。 1234567891011121314151617181920#include<iostream>using namespace std;int a[10];int z,f,l;int main(){ for(int i=0;i<10;i++){ cin>>a[i]; } for(int i=0;i<...

2026年1月8日

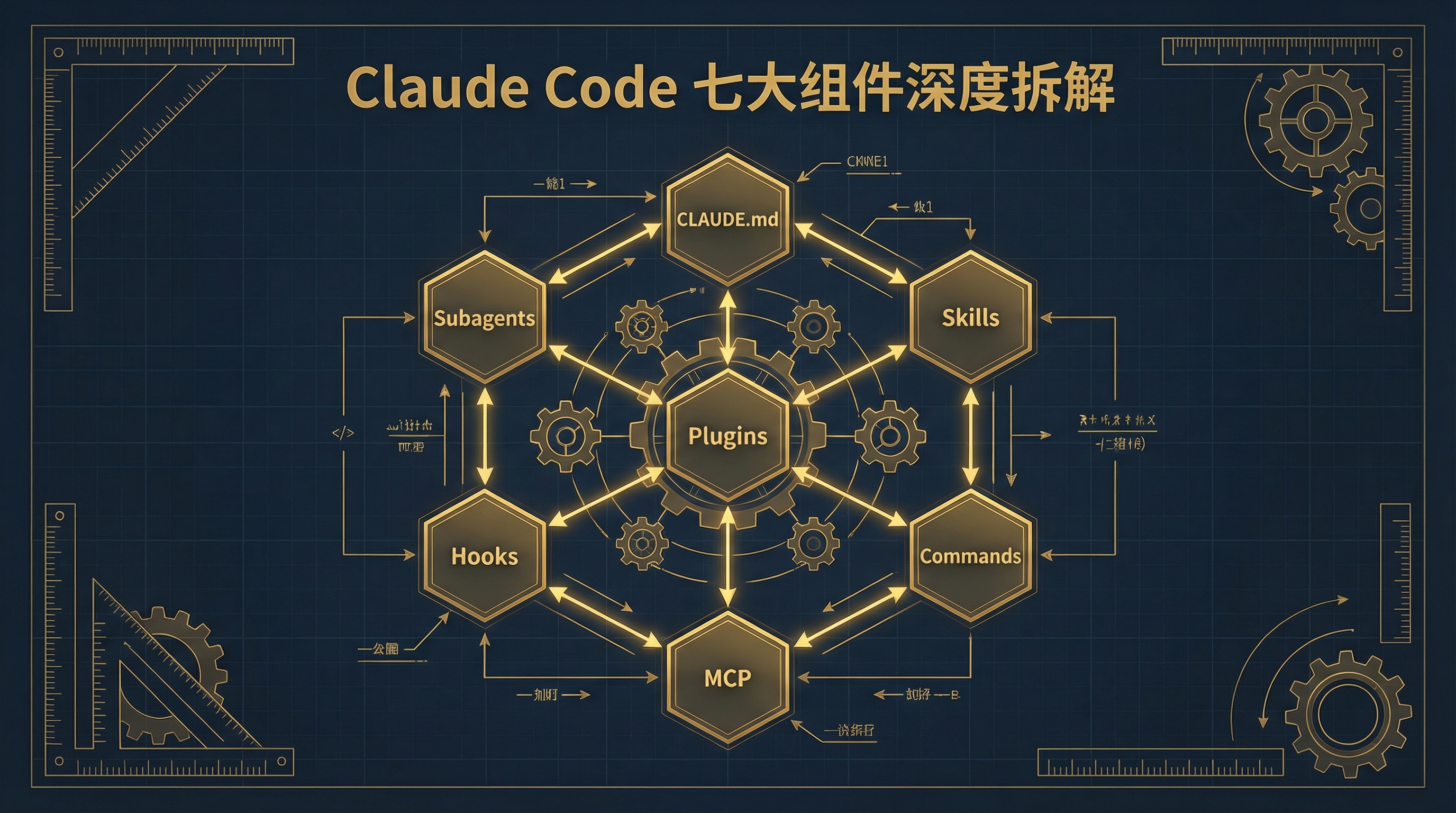

下午 12:30 出宿舍,中午鸡腿饭,1点回实验室 GLM Pro Plan 旺仔任务 ✅ 成功送货 Discord 注册成功但进不了群,自动化流程卡住 Telegram 搞到5积分,输入失败还被扣完了,血亏 来回折腾到3点,开始有点累 下午续 3点后转战个人博客搭建,解决了GitHub日历不显示 + 图片更新问题 4点搞定博客基础架构,后续规划:学习日志/日记/论文笔记全部托管,用 GLM API + Claude Code 自动化管理 研究极客时间内容转PDF脚本,找到开源方案并成功下载课程 学了 Claude Code 的 SDD 分层方法论(spec/plan/tasks/constitution),给自己的 API 项目定了大项目级别 晚上 5:30 吃饭,食堂快餐(胡萝卜牛腩 + 椒盐鸡柳) 7点散步,8点去好想来买了200块零食,来回溜达了1小时 继续推进课题:整理项目文档 + 论文知识点梳理 + 数据解法深入理解 状态精力 7/10,情绪 5/10 事情太多,多线程并发把注意力打散了,心态有点崩。 健康打卡 早餐:❌ 没吃 午餐:鸡腿饭 晚餐:胡萝卜牛...

2026年1月7日

上午 | 常熟研学考察 参观三家企业:北京大学苏州工程苏南研究院(材料方向,校政企合作)、常熟国家大学科技园(低空经济等高科技)、昆承湖周边 了解常熟人才引进策略,整体还不错 下午 | 尚湖游玩 5A级景区,风景很美,逛到2点集合 撞了9次钟,仪式感拉满,拍了一堆照片 4点回到学校 晚上 | 学习+折腾 看完罗永浩访谈Tim,全程3h,信息量巨大,整理了完整笔记 论文阅读Day06:ViT 把近30天论文重命名+编号,研究生系统录入科研成果 折腾ChatGPT老兵认证,Discord+电报搞了半小时没搞定,心态爆炸,止损 罗永浩访谈Tim笔记摘要关于Tim的成长路径: 出身杭州工薪家庭,童年全托幼儿园,初中沉迷《冒险岛》成绩暴跌,后赴英留学 高中因拍毕业典礼视频”首次获得现实世界认可”,从此入行 从个体户发展到160人团队,五年才20万粉,2019年爆发式增长 商业模式启发: “羊毛不出在羊身上”——内容免费获客,电商变现,获客成本仅同行1/15 坚持不融资,保持财务独立 评测标”体验”不标”评测”,维持内容独立性 AI判断: “AI将在2年内替代剪辑、制图...

2026年1月6日

上午 | 论文+课程 下载好30篇论文,读完DenseNet并写了Day05笔记 核心收获:从ResNet的”+x”到DenseNet的”[x0,x1,…x]”,连接方式的演化就是深度学习进化史 充值极客时间买了《AI原生工作流实战》,准备用Claude Code搭建个人工作流 下午 | 琴湖之夜活动 坐了两小时大巴到常熟,参加”未来共生 琴湖之夜” 玩游戏送了咖啡,走了一整天,玩得挺开心 晚上 | 大富翁之夜 回宿舍和室友打大富翁,打到凌晨1点 战绩:第一个破产,完美收官 缓了一会,2点才睡 吃喝记录 中午:酒店自助,大虾+猪排+口水鸡,吃撑了 晚上:庆江南大餐 喝水:2000ml ✓ 散步:暴走一整天 ✓ 状态评分 精力:9/10(体力消耗大但状态在线) 情绪:6/10(大富翁第一个破产多少有点郁闷) 原定待办 vs 实际 ✅ 论文下载导入微信读书 ⏸ 小程序改完部署(顺延) ⏸ 博客写入日记/读书笔记(顺延) ⏸ 域名购买 + DNS配置(顺延) ⏸ 电脑文件整理 + 装Linux(顺延) ⏸ 整合claude聊天记录(顺延) ⏸ 抖音清理100个(顺延) ...

2026年1月5日

2026年1月5日今日事件博客修复(主线任务)折腾了挺久,bug一个接一个冒出来,最后发现是分支问题: master分支 → https://insistgang.github.io/ main分支 → https://insistgang-github-io.vercel.app 搞清楚映射关系后终于修好了,顺便把GitHub日历也修复了。 GLM相关 token监控找到了:https://open.bigmodel.cn/finance-center/bill/expensebill/monthlybillingdetails/2026-01 mcp识别图片功能学会了 周复盘写完了,文档整理在进行中。 论文阅读Day04,读了ResNet开山之作《Deep Residual Learning for Image Recognition》,从mHC→MUDD→ResNet追本溯源,终于理解残差连接这条路最初是怎么修出来的。朋友圈已发。 社交5点到10点半和涂涂思宇吃饭打牌。 意外事件第一次坐朋友车,被交警罚了30💸 健康打卡 散步 ✅ 喝水 ✅ 挺多 抖音清理 ❌ ...

第1周复盘(12.30-1.4)

跨年周 + 竞赛后恢复期。前半周在”收尾模式”:交付拖延任务、整理财务、处理杂务;后半周逐渐找回节奏,论文打卡启动、小程序推进。**主旋律是”从无序到有序”**——1/1是低谷(脑子乱、线程太多),1/4找到了”松弛且充实”的状态。 关键成果 50所A4纸映射代码交付——拖了两天的硬骨头终于啃掉 体育生AI小程序demo测试 + 雏形交付——核心项目在推进 论文打卡启动并坚持3天——mHC → MUDDFormer → Attention Is All You Need,形成节奏 取消3个大模型订阅——每月省60美元,财务断舍离 党支部述职报告 + 年度总结完成——行政任务清零 习惯追踪 习惯 完成情况 备注 每日论文阅读 3/6天 1/2启动,连续3天完成,形成打卡机制 散步习惯 1/6天 仅1/4完成(室内30分钟),其余天被挤掉 抖音收藏清理 1天 1/3清理100个,剩余约1200个 模式识别精力波动规律: 12/30-31:输出型任务完成度高,状态稳定 1/1:明显低谷——起床晚、脑子乱、整理文件越理越多 1/2-1/4:逐步恢复,1/4达到最...

2026年1月4日

今日金句:要做让自己觉得困难的事情。 心态记录早上到实验室,莫名紧张。仔细想了想来源:朋友圈论文打卡怕没读懂、任务太多做不完的迷茫、用”忙碌”定义自己价值的惯性。 和Claude聊完,找到一个锚点:我要的不是”做更多”,而是”看得清”。从无序到有序,会让我舒适。 晚上回看这一天,虽然也是”高并发”,但松弛、没有deadline压着,很享受。这才是健康的节奏。 今日完成 罗胖跨年演讲(4小时)+ 笔记 论文精读:Attention Is All You Need + 笔记 整理下载30篇论文,备好这个月的阅读弹药 小程序雏形交付 + bug修复 + 题量扩充 Hexo博客找回23年版本,更新到最新 小红书发布复试招生 长三角比赛奖项登记 散步30分钟(室内,外面下雨) 明日待办 小程序剩余bug修复 + 部署 博客迁移收尾 今日感悟读罗胖演讲记住两句话: “谁离真实的问题越近,谁才能捧住金饭碗。” “逃离一致性。” 读Transformer原论文的收获:读开山之作,才知道后来者在改什么、为什么改。 今天最大的改变:7点散步计划虽然晚了一小时,但8点还是出门了。不...

2026年1月3日

🌞 今日完成📖 每日论文 Day 2《MUDDFormer: Breaking Residual Bottlenecks in Transformers via Multiway Dynamic Dense Connections》(彩云科技 & 北邮) 昨天读的mHC担心”路太宽会翻车”,今天的MUDDFormer抱怨”路太堵了,得修立交桥”。 核心痛点:Transformer变深后,残差流作为唯一通信通道被”过载”,限制跨层信息流动。 MUDD解法: Dense:每层直接看到之前所有层的输出 Dynamic:连接权重根据hidden state动态生成,本质是深度方向的Attention Multiway(核心):把输入解耦成Q、K、V、Residual四条流,各自独立密集连接 效果: MUDDPythia-2.8B ≈ Pythia-6.9B(2.4倍算力) 仅增加0.23%参数量和0.4%计算量 Scaling curve优于HC和DenseFormer 洞察:Value流从密集连接中获益最大,直接获取底层原始V信息能缓解”表征坍塌”。 读后感:mH...

2026年1月2日

2026年1月2日 星期五 晴 🎮 主队夺冠!今天是个好日子!北京WB对阵济南RW侠的总决赛,我的主队WB直接5:0碾压式夺冠! 说实话赛前还有点紧张,毕竟总决赛什么都可能发生。结果WB状态太好了,一局都没让,干脆利落拿下。看比赛的时候全程在喊,太爽了。 新年第二天就收获一个冠军,2026开门红! 📖 文献打卡Day01晚上静下心来读了DeepSeek跨年夜发的新论文《mHC: Manifold-Constrained Hyper-Connections》,是关于深度学习架构优化的。 核心思路挺有意思:Hyper-Connections把残差流扩宽了,性能涨了但训练崩了。作者的解法不是把路改窄,而是改交通规则——用双随机矩阵约束,让信号传播变成”凸组合”,能量守恒。 读完发了朋友圈打卡,打算坚持到年底,一日练一日功嘛。 💡 今日最大收获发现微信读书可以直接看英文文献,而且能做中英文对照翻译! 以前看英文论文要么硬啃,要么用付费软件翻译,现在微信读书直接搞定了。界面干净,翻译质量也还行,关键是免费。 这个发现太实用了,以后读文献的效率能提高不少。 📝 小结 ✅ 北京W...